Внедрение искусственного интеллекта (AI) на рабочих местах происходит настолько стремительно, что большинство организаций просто не успевают обеспечить его безопасность. Использование ИИ сотрудниками становится всё менее контролируемым и всё более рискованным — и новые данные это подтверждают!

Согласно свежему исследованию компании Cyberhaven, специализирующейся на безопасности данных с использованием ИИ, почти 40% всех взаимодействий сотрудников с инструментами искусственного интеллекта теперь затрагивают конфиденциальные корпоративные данные. Пока работники обходят официальные каналы, используя специализированные инструменты вроде Claude и DeepSeek, организации оказываются разделены на «первопроходцев» и «отстающих», которые теряют контроль над своими ценнейшими информационными активами.

Исследование Cyberhaven: шокирующие цифры

Лаборатория Cyberhaven Labs опубликовала свои выводы в четверг, основываясь на отслеживании перемещения данных между конечными устройствами, SaaS-приложениями и инструментами ИИ в реальном времени. Во многих случаях компании отдают приоритет росту и экспериментам, а вопросы безопасности, управления и контроля отходят на второй план.

«Для многих организаций использование ИИ напоминает Дикий Запад, — говорится в отчете. — Инструменты распространяются быстрее, чем политики безопасности, использование сотрудниками часто опережает возможности мониторинга, а конфиденциальные данные перемещаются между моделями, приложениями и учетными записями с минимальным централизованным контролем».

Пять ключевых открытий исследования

- Поляризация внедрения: Небольшая группа компаний-первопроходцев активно внедряет сотни инструментов ИИ для почти 70% своего персонала. В то же время отстающие организации застряли на уровне внедрения в 2%. Эта пропасть создает вакуум, где сотрудники, движимые требованиями продуктивности, обходят корпоративные ограничения, создавая собственные «теневые» экосистемы ИИ.

- Китайские модели прорываются на запад: Произошёл удивительный сдвиг в балансе сил ИИ — китайские модели с открытыми весами практически мгновенно перешли из разряда аутсайдеров в корпоративные стандарты. Такие продукты, как DeepSeek, вызывают ошеломляющий рост использования ИИ на конечных устройствах.

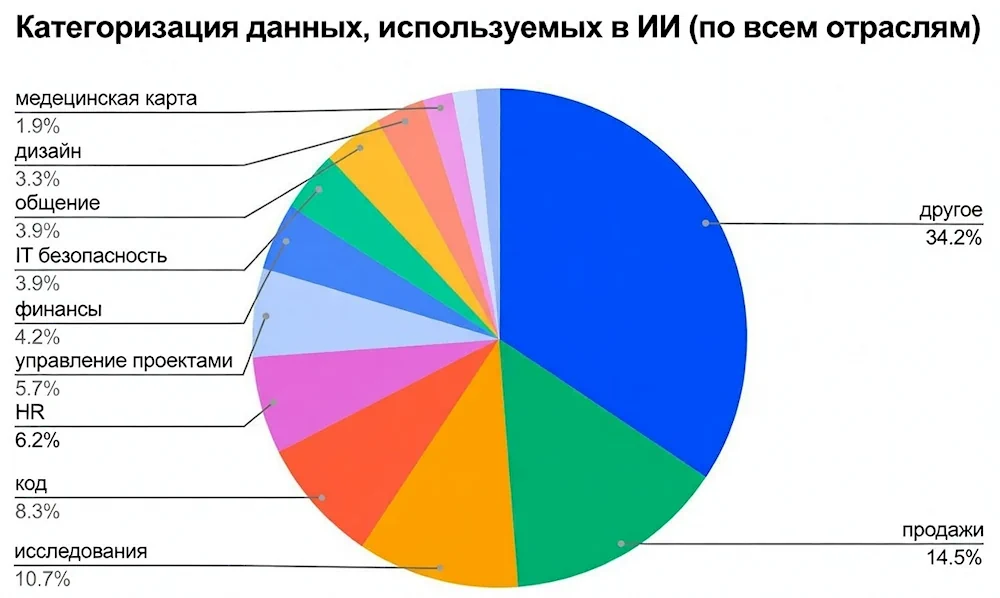

- Конфиденциальные данные под угрозой: Тревожные 39,7% взаимодействий с ИИ затрагивают чувствительные данные. Сотрудники загружают в системы ИИ широкий спектр конфиденциальной бизнес-информации: исходный код, исследования, данные о продажах, кадровые и финансовые сведения.

- «Теневой» ИИ превосходит корпоративные инструменты: 60% использования Claude и Perplexity происходит через личные аккаунты сотрудников. Эти специализированные инструменты предлагают пользовательский опыт и полезность, превосходящие санкционированные корпоративные аналоги.

- Рискованные приложения доминируют: 82% из топ-100 приложений генеративного ИИ классифицируются как «рискованные». Сотрудники отдают приоритет бесшовной доступности, а не официальным каналам, выбирая нишевые приложения со специализированными рабочими процессами.

Экспертное мнение: что делать организациям?

«Организациям становится всё сложнее обеспечивать безопасность широкого использования инструментов, но они могут и должны гарантировать, что их решения для защиты данных включают мониторинг использования ИИ», — заявил TechNewsWorld генеральный директор Cyberhaven Нишант Доши.

По словам Доши, компании-первопроходцы скорее всего реализуют официальную корпоративную стратегию, поощряющую сотрудников внедрять ИИ в повседневную работу. Это поощрение затем приводит к более разрешительной внутренней культуре в отношении экспериментов с новыми функциями и технологиями ИИ — санкционированными или нет.

«Отстающие компании в основном сдерживаются политикой безопасности «сначала блокировать» и фрагментированными устаревшими системами данных, которые делают официальную интеграцию слишком рискованной или сложной», — объяснил он.

Будущее корпоративного ИИ: что нас ждет?

Доши прогнозирует, что использование ИИ — санкционированное или нет — продолжит расти. Количество используемых ИИ-приложений и процент сотрудников, их использующих, станут важными показателями для компаний, которые внедрили ИИ или планируют это сделать для достижения стратегических преимуществ в производительности.

«Некоторые называли 2025 год Годом ИИ-агентов. Отчасти это правда, но я предсказываю, что в ближайшие годы всё больше предприятий будут разрабатывать и внедрять ИИ-агентов. Это только начало, что делает безопасность и управление этими инструментами ещё более важными», — призвал эксперт.

А как обстоят дела в вашей компании? Сталкивались ли вы или ваши коллеги с «теневым» использованием ИИ? Считаете ли вы, что политика «сначала блокировать» устарела в эпоху стремительного технологического прогресса, или же строгий контроль — единственный способ защитить корпоративные секреты? Поделитесь своим опытом, мнением и историями в комментариях ниже! Давайте обсудим, как найти баланс между инновационной свободой и необходимой безопасностью в новой цифровой реальности. Ваш практический взгляд может стать ценным советом для других читателей! 💬👇